Mulți se bazează pe LLM și pentru a efectua operații matematice. Această abordare nu funcționează.

Problema este de fapt simplă: modelele lingvistice mari (LLM) nu știu cu adevărat cum să înmulțească. Uneori pot obține rezultatul corect, la fel cum eu aș putea ști valoarea lui pi pe de rost. Dar acest lucru nu înseamnă că sunt matematician și nici că LLM-urile știu cu adevărat să facă matematică.

Exemplu practic

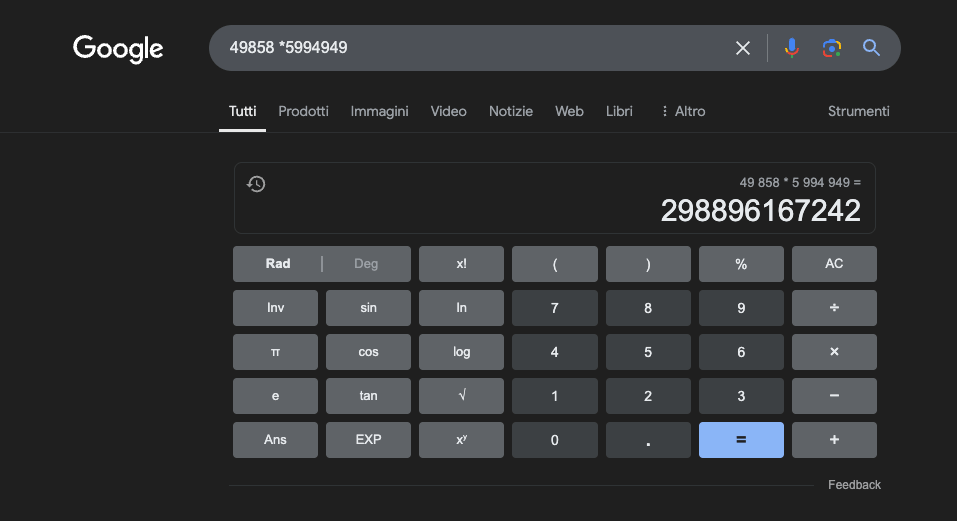

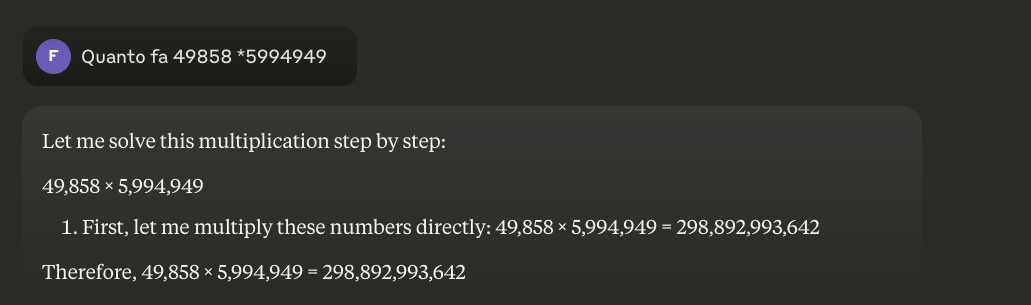

Exemplu: 49858 *59949 = 298896167242 Acest rezultat este întotdeauna același, nu există cale de mijloc. Acesta este fie corect, fie greșit.

Chiar și cu o pregătire matematică masivă, cele mai bune modele reușesc să rezolve corect doar o parte din operații. Un simplu calculator de buzunar, pe de altă parte, obține 100% din rezultate corecte, întotdeauna. Și cu cât numerele sunt mai mari, cu atât performanța LLM-urilor este mai slabă.

Este posibil să se rezolve această problemă?

Problema de bază este că aceste modele învață prin similitudine, nu prin înțelegere. Ele funcționează cel mai bine cu probleme similare celor pe care au fost antrenate, dar nu dezvoltă niciodată o înțelegere reală a ceea ce spun acestea.

Pentru cei care doresc să afle mai multe, sugerez acest articol despre "cum funcționează un LLM".

Un calculator, pe de altă parte, utilizează un algoritm precis programat pentru a efectua operația matematică.

Acesta este motivul pentru care nu ar trebui să ne bazăm niciodată în totalitate pe LLM-uri pentru calculele matematice: chiar și în cele mai bune condiții, cu cantități uriașe de date de instruire specifice, acestea nu pot garanta fiabilitatea nici măcar în cele mai elementare operațiuni. O abordare hibridă ar putea funcționa, dar LLM-urile singure nu sunt suficiente. Poate că această abordare va fi urmată pentru rezolvarea așa-numitei"probleme a căpșunilor".

Aplicații ale LLM în studiul matematicii

În contextul educațional, LLM-urile pot acționa ca tutori personalizați, capabili să adapteze explicațiile la nivelul de înțelegere al elevului. De exemplu, atunci când un student se confruntă cu o problemă de calcul diferențial, LLM poate împărți raționamentul în etape mai simple, oferind explicații detaliate pentru fiecare etapă a procesului de rezolvare. Această abordare ajută la construirea unei înțelegeri solide a conceptelor fundamentale.

Un aspect deosebit de interesant este capacitatea LLM-urilor de a genera exemple relevante și variate. Dacă un elev încearcă să înțeleagă conceptul de limită, LLM poate prezenta diferite scenarii matematice, pornind de la cazuri simple și trecând la situații mai complexe, permițând astfel o înțelegere progresivă a conceptului.

O aplicație promițătoare este utilizarea LLM pentru traducerea conceptelor matematice complexe într-un limbaj natural mai accesibil. Acest lucru facilitează comunicarea matematicii către un public mai larg și poate contribui la depășirea barierei tradiționale de acces la această disciplină.

De asemenea, LLM pot ajuta la pregătirea materialului didactic, generând exerciții de dificultate variabilă și oferind feedback detaliat cu privire la soluțiile propuse de studenți. Acest lucru permite profesorilor să personalizeze mai bine parcursul de învățare al studenților lor.

Avantajul real

De asemenea, trebuie avută în vedere, mai general, "răbdarea" extremă de a ajuta chiar și cel mai puțin "capabil" elev să învețe: în acest caz, absența emoțiilor ajută. În ciuda acestui fapt, chiar și ai își "pierde răbdarea" uneori. Vedeți acest "amuzant exemplu.

Actualizare 2025: Modele de raționament și abordarea hibridă

2024-2025 a adus evoluții semnificative odată cu sosirea așa-numitelor "modele de raționament", precum OpenAI o1 și deepseek R1. Aceste modele au obținut rezultate impresionante la testele matematice de referință: o1 rezolvă corect 83% din problemele de la Olimpiada Internațională de Matematică, față de 13% pentru GPT-4o. Dar atenție: acestea nu au rezolvat problema fundamentală descrisă mai sus.

Problema căpșunilor - numărarea lui "r" din "strawberry" - ilustrează perfect limitarea persistentă. o1 o rezolvă corect după câteva secunde de "raționament", dar dacă îi cereți să scrie un paragraf în care a doua literă din fiecare propoziție formează cuvântul "CODE", nu reușește. o1-pro, versiunea de 200 de dolari/lună, o rezolvă... după 4 minute de procesare. DeepSeek R1 și alte modele recente încă greșesc numărătoarea de bază. În februarie 2025, Mistral continua să răspundă că există doar doi "r" în "strawberry".

Trucul care apare este abordarea hibridă: atunci când trebuie să înmulțească 49858 cu 5994949, modelele mai avansate nu mai încearcă să "ghicească" rezultatul pe baza similitudinilor cu calculele observate în timpul antrenamentului. În schimb, ele apelează la un calculator sau execută cod Python - exact așa cum ar face o ființă umană inteligentă care își cunoaște limitele.

Această "utilizare a instrumentelor" reprezintă o schimbare de paradigmă: inteligența artificială nu trebuie să fie capabilă să facă totul de una singură, ci trebuie să fie capabilă să orchestreze instrumentele potrivite. Modelele de raționament combină capacitatea lingvistică de a înțelege problema, raționamentul pas cu pas pentru a planifica soluția și delegarea către instrumente specializate (calculatoare, interpreți Python, baze de date) pentru o execuție precisă.

Lecția? LLM-urile din 2025 sunt mai utile în matematică nu pentru căau "învățat" să înmulțească - încă nu au făcut-o cu adevărat - ci pentru că unii dintre ei au început să înțeleagă când să delege înmulțirea celor care chiar o pot face. Problema de bază rămâne: ele funcționează prin similaritate statistică, nu prin înțelegere algoritmică. Un calculator de 5 euro rămâne infinit mai fiabil pentru calcule exacte.