Înțelepciunea convențională spune: „Dacă nu doriți ca datele dvs. să fie utilizate, renunțați la toate”.

Noi spunem: „Dacă datele tale sunt colectate oricum, este mai logic să influențezi modul în care sunt utilizate.”

Nu este vorba despre „Ar trebui companiile să dețină datele mele?” (Deja le dețin).

Întrebarea reală este: „Ar trebui ca datele mele să contribuie la crearea unei inteligențe artificiale mai bune pentru toată lumea?”

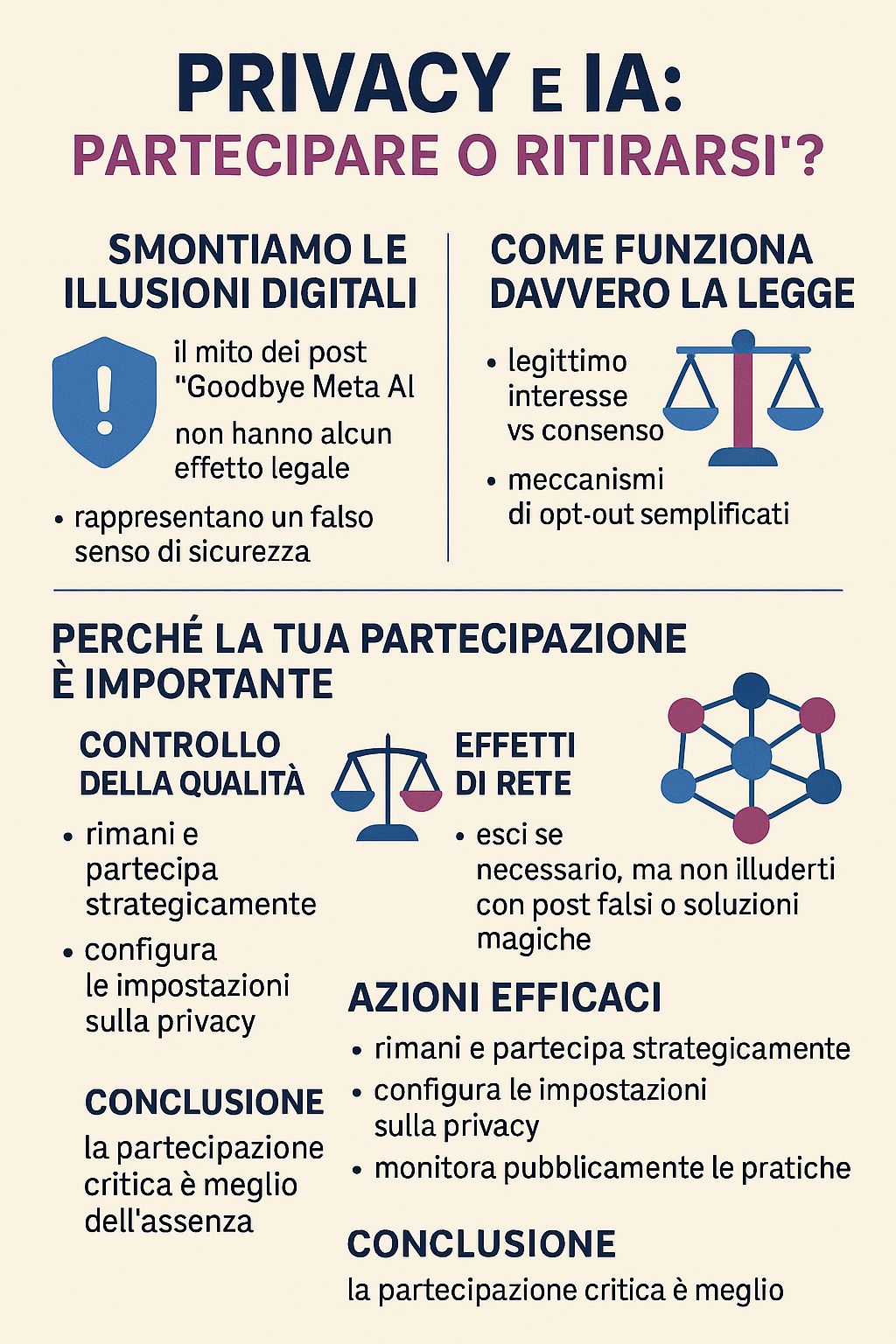

Înainte de a construi un argument serios, este esențial să demontăm o iluzie periculoasă care circulă pe rețelele sociale: postările virale „Goodbye Meta AI” care promit să vă protejeze datele pur și simplu prin distribuirea unui mesaj.

Adevărul incomod: aceste postări sunt complet false și te pot face mai vulnerabil.

După cum explică chiar Meta, „distribuirea mesajului «Goodbye Meta AI» nu constituie o formă validă de opoziție”. Aceste postări:

Succesul viral al acestor postări relevă o problemă mai profundă: preferăm soluții simple și iluzorii în locul deciziilor complexe și informate. Distribuirea unei postări ne face să ne simțim activi, fără a fi nevoie să depunem efortul de a înțelege cu adevărat cum funcționează drepturile noastre digitale.

Dar confidențialitatea nu poate fi apărată cu meme. Ea este apărată cu cunoștințe și acțiuni conștiente.

Începând cu 31 mai 2025, Meta a implementat un nou regim pentru instruirea în domeniul IA, utilizând „interesul legitim” ca bază juridică în locul consimțământului. Nu este vorba de o lacună, ci de un instrument juridic prevăzut de RGPD.

Interesul legitim permite companiilor să prelucreze date fără consimțământul explicit al utilizatorului, dacă pot demonstra că interesul lor nu prevalează asupra drepturilor utilizatorului. Acest lucru creează o zonă gri în care companiile „adaptează legea” prin evaluări interne.

Utilizarea datelor neanonimizate implică „riscuri ridicate de inversare a modelului, scurgeri de memorare și vulnerabilități de extragere”. Puterea de calcul necesară înseamnă că numai actorii cu o capacitate foarte mare pot exploata în mod eficient aceste date, creând asimetrii sistemice între cetățeni și marile corporații.

Acum că am clarificat realitățile juridice și tehnice, să construim argumentele în favoarea participării strategice.

Când persoanele conștiente se retrag, IA se antrenează pe cei care rămân. Doriți ca sistemele IA să se bazeze în principal pe date provenite de la persoane care:

Părtinirea în IA apare atunci când datele de antrenare nu sunt reprezentative. Participarea dvs. contribuie la asigurarea:

Sistemele de IA se îmbunătățesc odată cu scara și diversitatea:

Dacă utilizați funcții bazate pe inteligență artificială (căutare, traducere, recomandări, instrumente de accesibilitate), participarea dvs. contribuie la îmbunătățirea acestora pentru toată lumea, inclusiv pentru viitorii utilizatori care au cea mai mare nevoie de ele.

Confidențialitatea dvs. nu se modifică în mod semnificativ între opțiunea de acceptare și cea de refuzare a AI. Aceleași date sunt deja utilizate pentru:

Diferența constă în faptul dacă aceste date contribuie și la îmbunătățirea IA pentru toată lumea sau servesc doar intereselor comerciale imediate ale platformei.

Tocmai de aceea, persoanele responsabile ca dumneavoastră ar trebui să participe. Retragerea nu oprește dezvoltarea IA, ci pur și simplu vă elimină vocea din acest proces.

Sistemele de IA vor fi dezvoltate indiferent de situație. Întrebarea este: cu sau fără contribuția persoanelor care gândesc critic asupra acestor probleme?

Este de înțeles. Dar ia în considerare următorul aspect: ai prefera ca sistemele de IA să fie construite cu sau fără contribuția persoanelor care împărtășesc scepticismul tău față de marile corporații?

Scepticismul tău este tocmai motivul pentru care participarea ta critică este valoroasă.

Inteligența artificială devine o realitate, indiferent dacă participați sau nu.

Alegerea ta nu este dacă AI va fi construită, ci dacă AI care va fi construită va reflecta valorile și perspectivele oamenilor care se gândesc cu atenție la aceste probleme.

Renunțarea este ca și cum nu ai vota. Nu oprește alegerile; înseamnă doar că rezultatul nu va ține cont de contribuția ta.

Într-o lume în care numai actorii cu capacități de calcul extrem de ridicate pot interpreta și exploata în mod eficient aceste date, vocea ta critică în procesul de formare poate avea un impact mai mare decât absența ta.

Rămâneți și participați strategic dacă:

Și între timp:

Dar nu vă lăsați păcăliți de:

Renunțarea individuală are un impact minim asupra confidențialității dvs., dar rămânerea în sistem are un impact real asupra tuturor.

Într-o lume în care sistemele de inteligență artificială vor determina fluxul de informații, deciziile și interacțiunile dintre oameni și tehnologie, întrebarea nu este dacă aceste sisteme ar trebui să existe, ci dacă ar trebui să includă perspectiva unor oameni reflexivi și critici, precum dumneavoastră.

Uneori, cea mai radicală acțiune este să nu renunți. Adesea, cea mai radicală cale este să rămâi și să te asiguri că vocea ta este auzită.

Anonim

Nu este vorba despre a avea încredere oarbă în companii sau a ignora problemele legate de confidențialitate. Este vorba despre recunoașterea faptului că confidențialitatea nu se apără cu meme, ci cu participare strategică și informată.

Într-un ecosistem în care asimetriile de putere sunt enorme, vocea ta critică în formarea în domeniul IA poate avea un impact mai mare decât absența ta protestatară.

Indiferent de alegerea ta, alege cu înțelepciune, nu pe baza iluziilor digitale.

Un paragraf de simpatie și pentru „pustnicii confidențialității” – acele suflete pure care cred că pot scăpa complet de urmărirea digitală trăind offline, ca călugării tibetani în 2025.

Atenție, spoiler: chiar dacă te muți într-o cabană izolată din Dolomiți, datele tale sunt deja peste tot. Medicul tău de familie folosește sisteme digitale. Banca la care îți păstrezi economiile pentru a cumpăra lemne de foc urmărește fiecare tranzacție. Supermarketul din sat are camere de supraveghere și sisteme de plată electronice. Chiar și poștașul care îți livrează facturile contribuie la seturile de date logistice care alimentează algoritmii de optimizare.

Retragerea totală din lumea digitală în 2025 înseamnă, în esență, excluderea din societatea civilă. Poți renunța la Instagram, dar nu poți renunța la sistemele de sănătate, bancare, educaționale sau de ocupare a forței de muncă fără consecințe dramatice asupra calității vieții tale.

Și în timp ce vă construiți cabana anti-5G, datele dvs. continuă să existe în bazele de date ale spitalelor, băncilor, companiilor de asigurări, autorităților locale și ale administrației fiscale și sunt în continuare utilizate pentru a antrena sisteme care vor influența generațiile viitoare.

Paradoxul pustnicului: izolarea ta protestatară nu împiedică sistemele de IA să fie antrenate pe baza datelor provenite de la indivizi mai puțin conștienți, dar te exclude de la posibilitatea de a influența dezvoltarea lor în direcții mai etice.

În esență, ai atins puritatea morală neîntinată a cuiva care observă istoria din afară, în timp ce alții – mai puțin iluminați, dar mai prezenți – scriu regulile jocului.

Indiferent de alegerea ta, alege cu înțelepciune, nu pe baza iluziilor digitale.

Articole citate:

Informații suplimentare privind RGPD și interesul legitim:

Resurse oficiale:

Pentru măsuri concrete: dacă vă aflați în Europa, verificați procedurile oficiale de renunțare la autoritatea pentru protecția datelor. Pentru informații generale, consultați setările de confidențialitate și termenii și condițiile de utilizare ale platformei dvs. Și nu uitați: nicio postare pe rețelele sociale nu are valoare juridică.